GPT-3.5 Turbo란?

GPT-3.5 Turbo의 출시로 OpenAI는 강력한 언어 모델의 새로운 시대를 열었습니다. 이 최신 버전은 이전 버전인 GPT-3.5가 구축한 놀라운 기반을 바탕으로 구축되었으며 자연어 이해 및 생성 분야에서 상당한 발전을 이루었습니다.

GPT-3.5와 비교할 때 GPT-3.5 Turbo는 상당한 향상을 제공합니다. AI 기반 언어 모델의 강력한 경쟁자로 자리매김했습니다. 더 긴 정보 스트림을 분석하는 GPT-3.5 Turbo의 용량은 가장 눈에 띄는 개선 사항 중 하나입니다.

GPT-3.5 Turbo의 새 버전은 16K 컨텍스트 창을 기본적으로 지원합니다. JSON 모드, 병렬 함수 호출 및 향상된 명령 따르기가 새로운 3.5 Turbo에서 지원됩니다. 내부 평가에 따르면 XML, YAML, JSON 생성 등 형식을 따르는 작업이 38% 향상된 것으로 나타났습니다.

개발자는 API에서 gpt-3.5-turbo-1106을 호출하여 이 새로운 모델에 액세스할 수 있습니다. get-3.5-turbo 이름을 사용하는 애플리케이션은 자동으로 새 모델로 업데이트됩니다. 하지만 2024년 6월 13일까지 API를 통해 gpt-3.5-turbo-0613을 제공하여 이전 모델에 계속 액세스할 수 있습니다.

GPT 3.5 Turbo의 주요 강점

GPT-3.5 Turbo는 주로 빠른 응답 시간과 확장성이 필수적인 시나리오를 위해 설계되었습니다. 빠른 반응 시간과 확장성이 필요한 상황에서는 GPT-3.5 Turbo가 탁월한 옵션입니다. 이 접근 방식이 제공하도록 설계된 신속한 답변은 실시간 애플리케이션에 필수적입니다.

낮은 대기 시간 시나리오를 관리할 수 있는 능력은 특히 빠른 피드백이 필수적인 애플리케이션의 경우 큰 장점입니다. 이러한 응답성은 지연이 사용자 경험에 부정적인 영향을 미칠 수 있는 대화형 챗봇 및 인스턴트 메시징 시스템과 같은 다양한 상황에서 매우 중요합니다.

속도 외에도 GPT-3.5 Turbo의 확장성은 중요한 특성입니다. 대용량 동시 요청을 원활하게 관리할 수 있으므로 광범위한 사용자 기반을 갖춘 애플리케이션에 이상적인 선택입니다. 이 기능은 사용량이 가장 많은 시간 동안 성능 수준을 유지하는 데 필수적입니다.

대용량 애플리케이션에서 GPT-3.5 Turbo의 비용 효율성 및 원활한 통합

GPT-3.5 Turbo의 대용량 사용에 대한 비용 효율성은 주목할 만합니다. 다른 모델보다 토큰당 비용이 저렴하므로 많은 요청을 처리하는 애플리케이션에 더욱 경제적인 선택이 됩니다.

- 훈련: $0.0080 / 1K 토큰

- 사용법 입력: $0.0120/ 1K 토큰

- 사용량 출력: $0.0120/ 1K 토큰

이 모델은 간단하고 직접적인 쿼리를 효율적으로 처리하고 기존 시스템에 원활하게 통합됩니다. 이러한 통합 용이성은 광범위한 수정 없이 AI 기능을 추가해야 하는 시스템에 특히 유용하므로 기업은 중단을 최소화하면서 서비스를 향상할 수 있습니다.

더 나은 성능을 위한 미세 조정 GPT 3.5 Turbo

GPT-3.5 Turbo는 미세 조정 옵션을 제공합니다.성능을 향상시키기 위해 특정 작업이나 산업을 추가로 사용자 정의합니다. 미세 조정GPT-4는올 가을에 옵니다.

다른 발전으로 OpenAI는 두 가지 향상된 GPT-3 기본 모델을 출시했습니다(배비지-002그리고다빈치-002) 페이지 매김을 활성화하고 “더 많은 확장성”을 제공하며 미세 조정할 수 있습니다. OpenAI는 2024년 1월 4일에 원래 GPT-3 기본 모델을 폐기할 계획입니다.

모델을 미세 조정함으로써 회사와 개발자는 모델을 특정 활동이나 산업에 더 잘 적용하여 특정 애플리케이션에 대한 성능을 향상시킬 수 있습니다. 이 프로세스를 통해 데이터세트에 대한 모델을 학습하고 필요에 따라 모델의 응답을 맞춤설정할 수 있습니다. 미세 조정을 위한 몇 가지 단계가 포함됩니다.

1단계: 데이터 준비

모델이 이해할 수 있는 형식으로 데이터세트를 준비해야 합니다. 이 데이터 세트는 지정된 역할(“시스템” 또는 “사용자”)과 콘텐츠가 포함된 일련의 메시지로 구성됩니다.

예제 데이터 형식:

| {“메시지”: [ { “role”: “시스템”, “콘텐츠”: “당신은 언제든지 단어를 철자를 만드는 어시스턴트입니다” }, { “역할”: “사용자”, “콘텐츠”: “이야기를 들려주네요 제발.” }, { “role”: “어시스턴트”, “콘텐츠”: “어느 날 한 학생이 학교에 가는 것.” } ]} |

| { “메시지”: [ { “role”: “system”, “content”: “당신은 가끔 단어 철자를 틀리는 어시스턴트입니다.” }, { “role”: “user”, “content”: “이야기를 들려주세요.” }, { “role”: “도우미”, “content”: “어느 날, 한 학생이 학교에 갔습니다.” } ] } |

2단계: 파일 업로드

데이터가 준비되면 OpenAI 서버에 업로드하세요.

파일 업로드를 위한 cURL 명령 예:

| 컬 https://api.openai.com/v1/files 연락해 주셔서 감사합니다. -H “Authorization: Bearer $OPENAI_API_KEY” 연락해 주셔서 감사합니다. -F “목적=미세 조정” 연락해 주셔서 감사합니다. -F “파일=@path_to_your_file” |

| 컬 https://api.openai.com/v1/files -H “권한 부여: $OPENAI_API_KEY 전달자” -F “목적=미세 조정” -F “파일=@path_to_your_file” |

$OPENAI_API_KEY를 API 키로 바꾸고 path_to_your_file을 데이터세트 파일 경로로 바꿉니다.

3단계: 미세 조정 작업 생성

데이터를 업로드한 후 미세 조정 작업을 생성합니다. 이 작업은 모델이 데이터로부터 학습을 시작하도록 지시합니다.

미세 조정 작업 생성을 위한 cURL 명령 예:

| 컬 https://api.openai.com/v1/fine_tuning/jobs 연락해 주셔서 감사합니다. -H “Content-Type: application/json” 연락해 주셔서 감사합니다. -H “Authorization: Bearer $OPENAI_API_KEY” 연락해 주셔서 감사합니다. -d ‘{ “training_file”: “TRAINING_FILE_ID”, “모델”: “gpt-3.5-turbo-0613” }’ |

| 컬 https://api.openai.com/v1/fine_tuning/jobs -H “콘텐츠 유형: 애플리케이션/JSON” -H “권한 부여: $OPENAI_API_KEY 전달자” -d ‘{ “training_file”: “TRAINING_FILE_ID”, “모델”: “gpt-3.5-turbo-0613” }’ |

TRAINING_FILE_ID를 파일을 업로드할 때 받은 ID로 바꾸세요.

4단계: 미세 조정된 모델 사용

미세 조정 프로세스가 완료되면 모델을 사용할 수 있습니다.

미세 조정된 모델을 사용하기 위한 cURL 명령 예:

| 컬 https://api.openai.com/v1/chat/completions -H “콘텐츠 유형: 애플리케이션/JSON”. -H “권한 부여: $OPENAI_API_KEY 전달자” -d ‘{ “모델”: “ft:gpt-3.5-turbo:org_id”, “메시지”: [ { “역할”: “시스템”, “content”: “가끔 잘못된 것을 잘못하는 조수입니다” }, { “역할”: “사용자”, “content”: “안녕하세요! 파인튜닝이 무엇인가요?” } ] }’ |

| 컬 https://api.openai.com/v1/chat/completions -H “콘텐츠 유형: 애플리케이션/json” -H “권한: 전달자 $OPENAI_API_KEY”\ -d ‘{ “모델”: “ft:gpt-3.5-turbo:org_id”, “메시지”: [ { “역할”: “시스템”, “content”: “당신은 가끔 단어 철자를 틀리는 어시스턴트입니다.” }, { “역할”: “사용자”, “content”: “안녕하세요! 미세 조정이 무엇인가요?” } ] }’ |

org_id를 조직의 ID로 바꾸세요.

왜 GPT-3.5 Turbo를 API를 통해 사용해야 할까요?

GPT-3.5 Turbo는 OpenAI의 가장 인기 있고 효율적인 언어 모델 중 하나로, 성능, 속도, 비용 사이에서 우수한 균형을 제공합니다. 채팅봇, AI 기반 애플리케이션, 자동화 워크플로우 등을 구축할 때 GPT-3.5 Turbo는 신뢰성 있고 확장 가능한 솔루션을 제공합니다. 다음은 API를 통해 사용해야 하는 이유입니다:

비용 효율적

GPT-3.5 Turbo는 GPT-4보다 훨씬 저렴하면서도 강력한 성능을 제공합니다. 이는 프리미엄 모델의 높은 비용 없이 강력한 AI 모델이 필요한 스타트업, 개발자, 기업에 이상적입니다. API 요금은 토큰 사용량에 기반하기 때문에 GPT-3.5 Turbo는 GPT-4의 비용의 일부만으로 확장 가능한 배포가 가능합니다.

빠른 응답 시간

저지연 상호작용을 최적화한 GPT-3.5 Turbo는 빠른 응답이 필수적인 실시간 애플리케이션에 완벽합니다. 고객 지원 챗봇, 인터랙티브 어시스턴트, 실시간 콘텐츠 생성 도구 등을 개발할 때 모델의 속도는 원활하고 끊김 없는 사용자 경험을 보장합니다.

대화 최적화 및 메모리 기능

기본 텍스트 완성 모델과 달리 GPT-3.5 Turbo는 다중 회화 대화를 위해 특별히 설계되었습니다. 이전 메시지의 맥락을 유지하여 동적이며 상호작용이 풍부한 대화에 적합합니다. 이 내장된 메모리 기능은 개발자가 광범위한 수동 맥락 관리 없이 자연스럽고 매력적인 대화형 AI 경험을 만들 수 있도록 합니다.

고도로 유연하고 맞춤형

API를 통해 다음과 같은 핵심 매개변수를 완전히 제어할 수 있습니다:

- 프롬프트 및 지침 – 모델의 행동을 특정 사용 사례에 맞게 조정합니다.

- 온도 – 응답의 창의성과 결정성 사이를 조정합니다.

- 최대 토큰 수 – 간결한 출력을 위해 응답 길이를 제한합니다.

- 시스템 메시지 – 모델의 톤과 역할을 안내합니다 (예: “당신은 도움이 되는 보조원입니다”).

이 유연성은 개발자가 전문적인 고객 서비스 봇부터 창의적인 글쓰기 보조 도구까지 다양한 응용 프로그램에 맞게 상호작용을 미세 조정할 수 있도록 합니다.

GPT-3.5 Turbo의 사용 사례

GPT-3.5 Turbo 모델은 다양한 응용 분야에 사용할 수 있습니다. 일부 예시로는 다음과 같습니다:

- FAQ 및 지원 문의 효율적으로 처리합니다.

- 기사, 이메일, 마케팅 콘텐츠를 빠르게 작성합니다.

- AI 튜터, 게임 NPC, 가상 비서를 구현합니다.

- 문서 요약, 핵심 인사이트 추출, 코드 스니펫 생성합니다.

- API 통합: GPT-3.5 Turbo를 모바일 또는 웹 앱에 통합 (React, Flutter 등).

- Slack/Discord 봇 구축.

- 노코드/로우코드 AI 워크플로우 생성 (Zapier, Make 등을 통해).

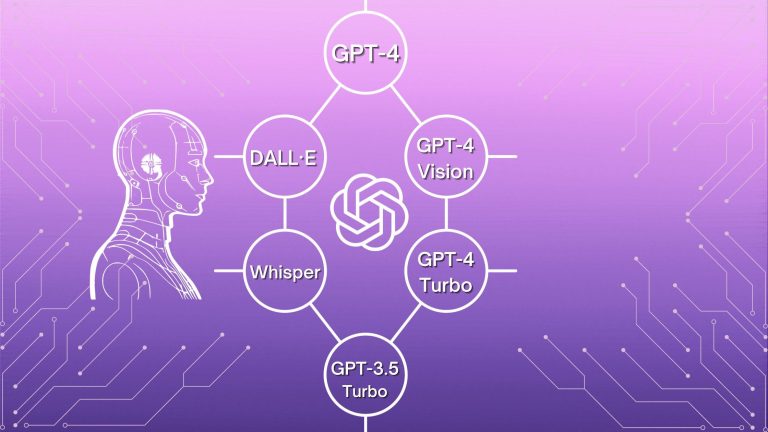

GPT-3.5 Turbo: API를 통해만 제공되는 레거시 모델

초기 챗GPT 인터페이스에서 GPT-3.5 Turbo는 인기 있고 비용 효율적인 옵션이었습니다. 이 모델은 GPT-4와 유사한 성능을 보여주었지만 더 빠르고 저렴했습니다. GPT-3.5 Turbo는 2021년 9월까지의 지식 범위를 가지고 4,096개의 출력 토큰을 반환했습니다. 오픈AI는 7월에 모든 원본 GPT-3 기반 모델을 비활성화했다고 발표했습니다. 대신 ada, Babbage, curie, Davinci를 대체하기 위해 babbage-002와 davinci-002를 제공했습니다.

저지능 모델인 GPT-3.5 Turbo는 언어와 코드를 이해하고 생성할 수 있습니다. Chat Completion API를 통해 채팅에 최적화되었지만, 채팅이 아닌 작업에도 사용할 수 있습니다. 2024년 7월, OpenAI는 무료 계정 사용자를 대상으로 GPT-3.5 Turbo를 GPT-4o mini로 교체했습니다. gpt=4o-mini는 빠르고 저렴하며 다모달(multimodal) 기능을 갖춘 모델입니다. 그러나 GPT-3.5 Turbo는 API에서 계속 사용 가능합니다.

결론

OpenAI의 GPT-3.5 Turbo 출시로 인공지능이 크게 발전했습니다. 이 최신 버전인 GPT-3.5는 이전 버전의 강력한 기반을 바탕으로 구축되었으며 자연어 생성 및 해석 분야에서 눈에 띄게 향상된 기능을 제공합니다. GPT-3.5 Turbo는 16K 컨텍스트 창을 통해 더 긴 정보 스트림을 처리할 수 있는 능력이 뛰어나 광범위한 애플리케이션에 매우 적합합니다.

자주 묻는 질문 (FAQs)

GPT-3.5 Turbo의 JSON 모드는 기능을 어떻게 향상합니까?

GPT-3.5 Turbo의 JSON 모드를 사용하면 보다 구조화된 데이터 처리가 가능합니다. 특히 데이터 직렬화 및 역직렬화와 관련된 작업에 유용하므로 XML, YAML, JSON과 같은 복잡한 데이터 형식을 더 쉽게 처리할 수 있습니다.

GPT-3.5 Turbo에서 병렬 함수 호출의 이점은 무엇입니까?

병렬 기능 호출을 통해 GPT-3.5 Turbo는 여러 작업을 동시에 수행할 수 있어 특히 멀티태스킹 애플리케이션에서 효율성과 속도가 크게 향상됩니다.

GPT-3.5 Turbo의 16K 컨텍스트 창은 이전 모델과 어떻게 비교됩니까?

GPT-3.5 Turbo의 16K 컨텍스트 창은 이전 모델보다 훨씬 더 커서 단일 프롬프트에서 더 확장된 텍스트를 처리할 수 있습니다. 이는 깊은 맥락 이해나 긴 데이터 분석이 필요한 애플리케이션에 주로 도움이 됩니다.

GPT-3.5 Turbo 사용에 제한이 있나요?

GPT-3.5 Turbo는 매우 효율적이고 다재다능하지만 특정 복잡한 언어 이해 작업에서는 보다 포괄적인 GPT-3.5 모델만큼 미묘한 차이가 없을 수 있습니다. 일부 시나리오에서는 깊이에 따른 속도와 확장성에 최적화되어 있습니다.

새로운 GPT-3.5 Turbo 모델의 자동 업데이트는 기존 애플리케이션에 어떤 영향을 미치나요?

get-3.5-turbo 이름을 사용하는 애플리케이션은 자동으로 새 모델 버전으로 업데이트되어 최신 개선 사항의 혜택을 누릴 수 있습니다. 그러나 개발자는 새 모델과의 호환성과 최적의 성능을 보장하기 위해 애플리케이션을 테스트해야 합니다.

OpenAI는 GPT-3.5 Turbo를 사용하는 개발자에게 어떤 종류의 지원을 제공합니까?

OpenAI는 문서, 커뮤니티 지원 및 직접적인 지원 채널을 제공하여 개발자가 애플리케이션에 GPT-3.5 Turbo를 통합하고 최적화할 수 있도록 돕습니다.